一、前言

OpenClaw 作为一款开源的、具备系统级操作权限的 AI 代理工具,在 2026 年迎来了爆发式发展。它能够将你的自然语言指令转化为实际的文件操作、程序控制等行为,真正意义上让 AI 帮你“干活”。

将 OpenClaw 与本地大模型推理工具 Ollama 结合,不仅能实现数据 100% 私有化、无需联网、零 API 成本,还能享受到如 Qwen2.5-Coder 这样强大的开源模型的推理能力。

- 数据隐私绝对安全:所有模型推理与指令执行均在本地完成,敏感数据永不离开你的电脑,适合处理办公文档和个人隐私。

- 零 API 成本,无限使用:告别按 token 计费的云端 API,本地部署后可以免费、无限制地使用。

- 断网可用,随时随地:无论是在飞机上还是网络受限的环境,只要电脑有电,你的 AI 助手就能工作。

- 代码能力特化:选择 Qwen2.5-Coder:7b 模型,它在代码生成、代码修复和代码推理方面表现优异,是程序员的绝佳拍档。

二、工具安装

1、硬件要求

- 显卡 (GPU):NVIDIA 显卡,建议显存 ≥8GB(如 RTX 4060/5060 系列),以保证流畅运行 7B 模型。如果没有独立显卡,也可以只用 CPU 跑,但速度会慢很多。

- 内存 (RAM):建议 ≥16GB,32GB 更佳。

- 磁盘空间:至少预留 20GB 剩余空间(主要用于存放模型文件)

2、软件要求

- 操作系统:Windows 11(本文基于此版本测试)。

- 终端工具:PowerShell(务必以管理员身份运行)。

- Node.js:版本需 ≥18.0.0。这是运行 OpenClaw 的核心依赖

3、安装“大脑”——Ollama 与 Qwen2.5-Coder

访问 Ollama 官网,下载 Windows 版本并双击安装。安装完成后,Ollama 会自动在后台运行(你可以在任务栏托盘中看到它的图标)

PowerShell 命令安装

irm https://ollama.com/install.ps1 | iex在 PowerShell 中验证安装:

ollama --version拉取 Qwen2.5-Coder:7b 模型:在 PowerShell 中执行以下命令,拉取我们需要的代码模型(大小约 4GB 左右,具体取决于量化版本)

ollama pull qwen2.5-coder:7b等待下载完成即可。如果想尝试更强的推理能力,也可以选择 qwen2.5-coder:14b 或 qwen3:8b,但需要确保你的显存足够。

查看本地 ollama 模型

ollama list

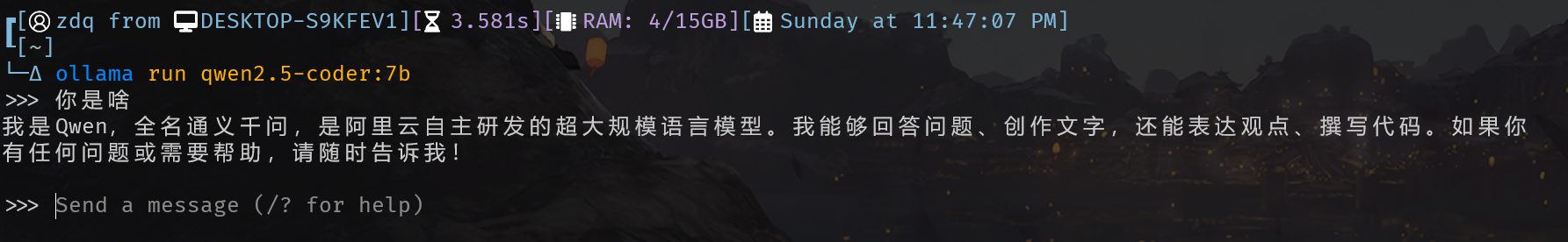

使用本地模型

ollama run qwen2.5-coder:7b

4、安装“躯体”——OpenClaw

Windows 用户 到 GitHub Releases 下载 nvm-setup.exe(建议用最新版)

安装 node.js 22.22.0 版本:在管理员身份的 PowerShell 中执行

# 安装指令

nvm install 22

# 使用指令

nvm use 22.22.0安装 openclaw:以管理员身份打开 PowerShell,输入:

npm install -g openclaw一键安装(PowerShell):以管理员身份打开 PowerShell,输入:

iwr -useb https://openclaw.ai/install.ps1 | iex如果遇到执行策略报错(常见于首次运行脚本),在 PowerShell 输入:

Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser安装完成后验证版本:

openclaw --version三、配置 openclaw

1、手动配置文件

找到以下两个 JSON 文件(路径中的 < 你的用户名> 记得替换):

C:\Users\< 你的用户名 >\.openclaw\openclaw.jsonC:\Users\< 你的用户名 >\.openclaw\agents\main\agent\models.json

用记事本或 VS Code 打开它们,替换之

openclaw.json

{

"agents": {

"defaults": {

"model": {"primary": "ollama/qwen2.5-coder:7b"},

"models": {"ollama/qwen2.5-coder:7b": {}

},

"workspace": "C:\\Users\\zdq\\.openclaw\\workspace"

}

},

"commands": {

"native": "auto",

"nativeSkills": "auto",

"ownerDisplay": "raw",

"restart": true

},

"gateway": {

"auth": {

"mode": "token",

"token": "1902zdq."

},

"bind": "loopback",

"mode": "local",

"nodes": {

"denyCommands": [

"camera.snap",

"camera.clip",

"screen.record",

"calendar.add",

"contacts.add",

"reminders.add"

]

},

"port": 18789,

"tailscale": {

"mode": "off",

"resetOnExit": false

}

},

"meta": {

"lastTouchedAt": "2026-03-01T04:12:10.354Z",

"lastTouchedVersion": "2026.2.26"

},

"models": {

"providers": {

"ollama": {

"api": "ollama",

"apiKey": "ollama-local",

"baseUrl": "http://:11434/v1",

"models": [

{

"contextWindow": 32768,

"cost": {

"cacheRead": 0,

"cacheWrite": 0,

"input": 0,

"output": 0

},

"id": "qwen2.5-coder:7b",

"input": [

"text"

],

"name": "qwen2.5-coder:7b"

}

]

}

}

},

"session": {"dmScope": "per-channel-peer"},

"skills": {

"install": {"nodeManager": "npm"}

},

"wizard": {

"lastRunAt": "2026-03-01T04:12:10.347Z",

"lastRunCommand": "onboard",

"lastRunMode": "local",

"lastRunVersion": "2026.2.26"

}

}models.json

{

"providers": {

"ollama": {

"baseUrl": "http://:11434/v1",

"api": "ollama",

"models": [

{

"id": "qwen2.5-coder:7b",

"name": "qwen2.5-coder:7b",

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32768,

"reasoning": false,

"maxTokens": 8192,

"api": "ollama"

}

],

"apiKey": "ollama-local"

}

}

}

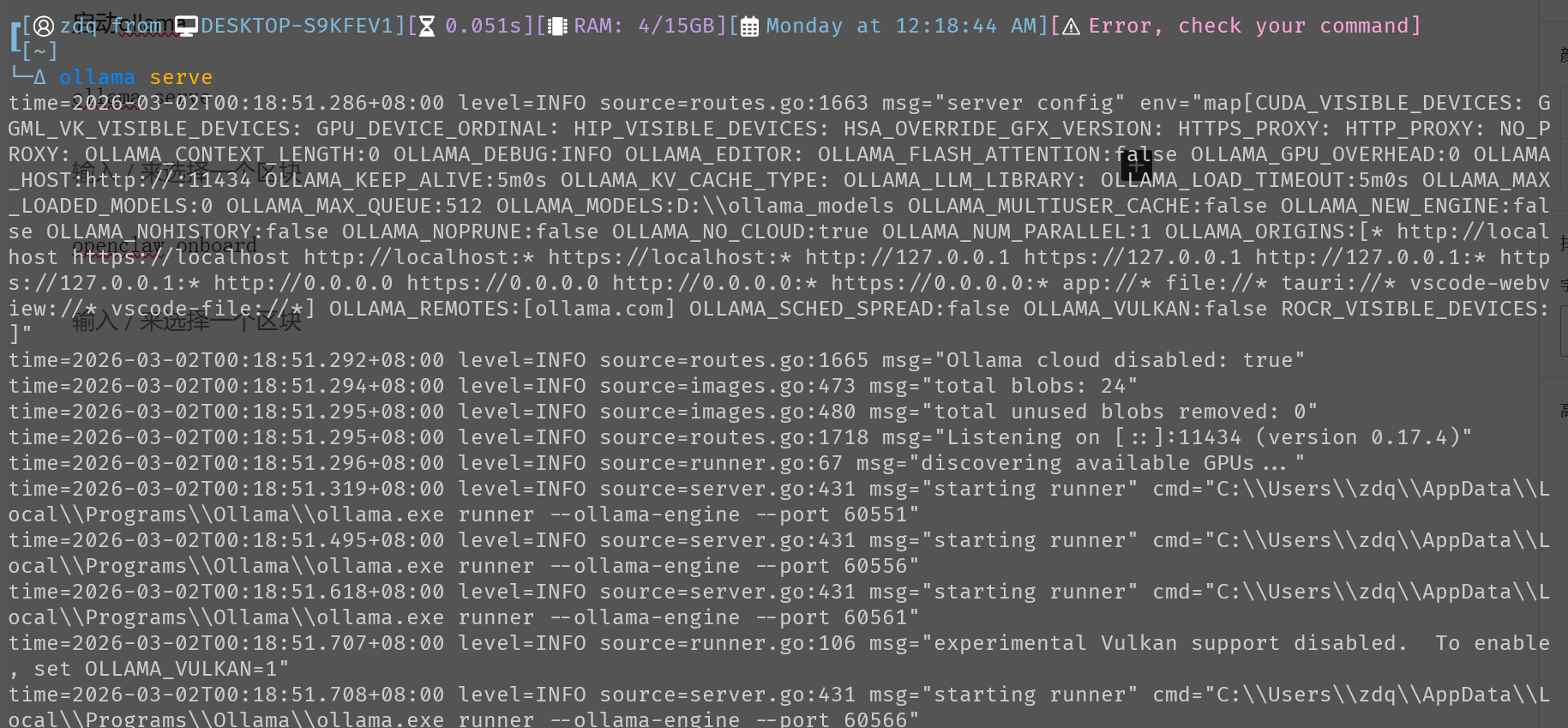

2、启动 openclaw

启动 ollama

ollama serve

启动 openclaw

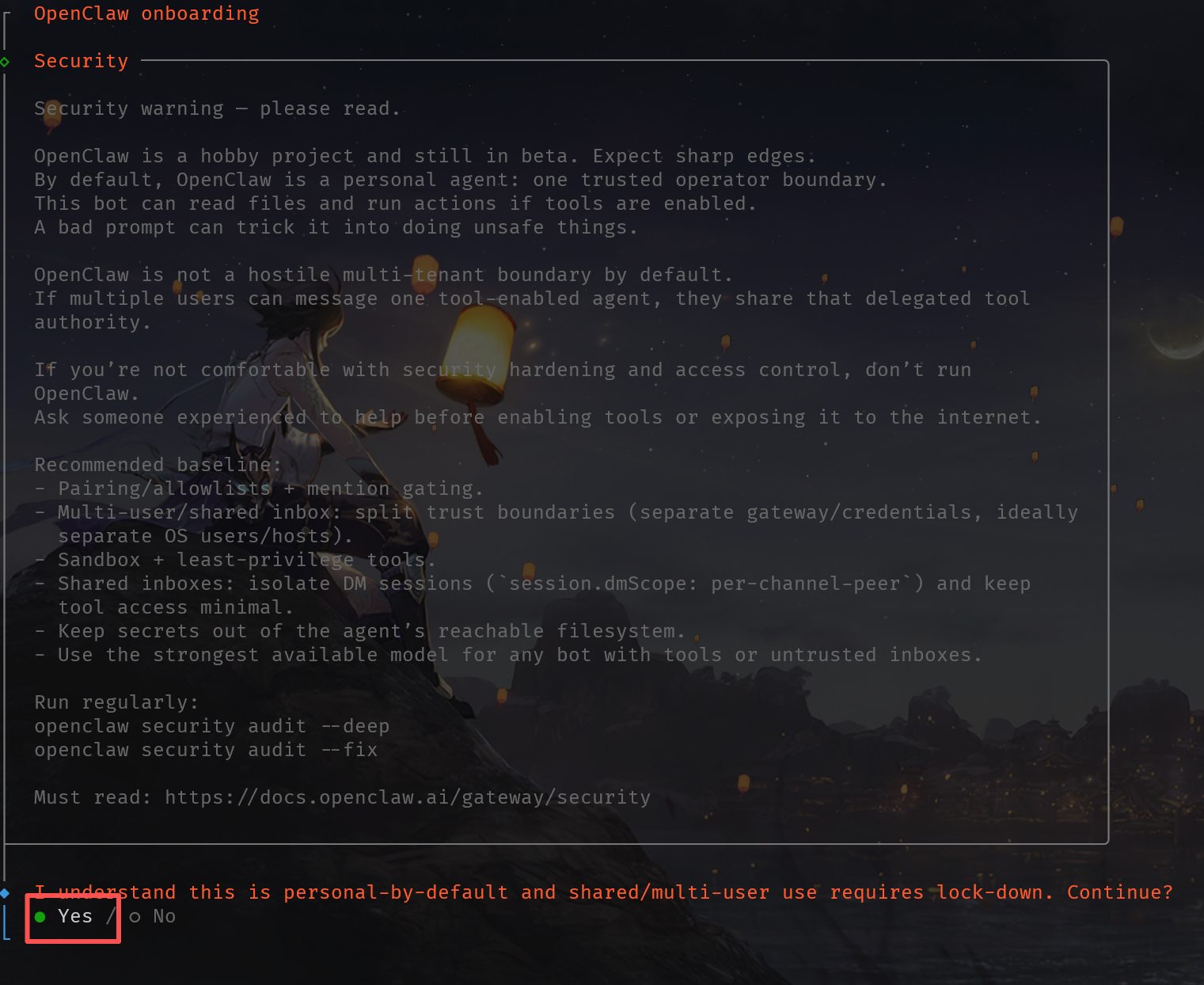

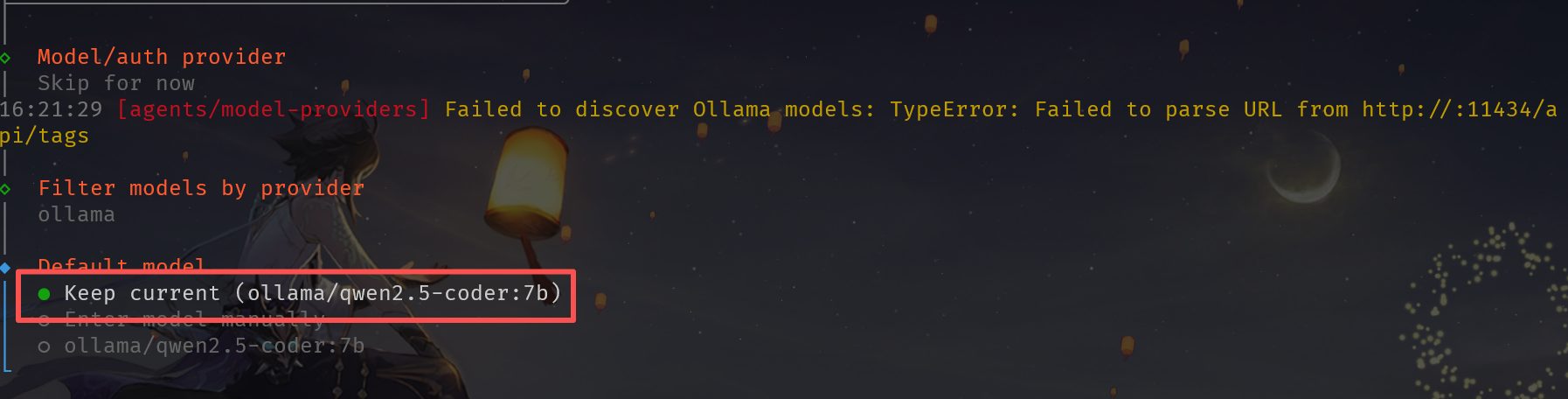

openclaw onboard同意协议

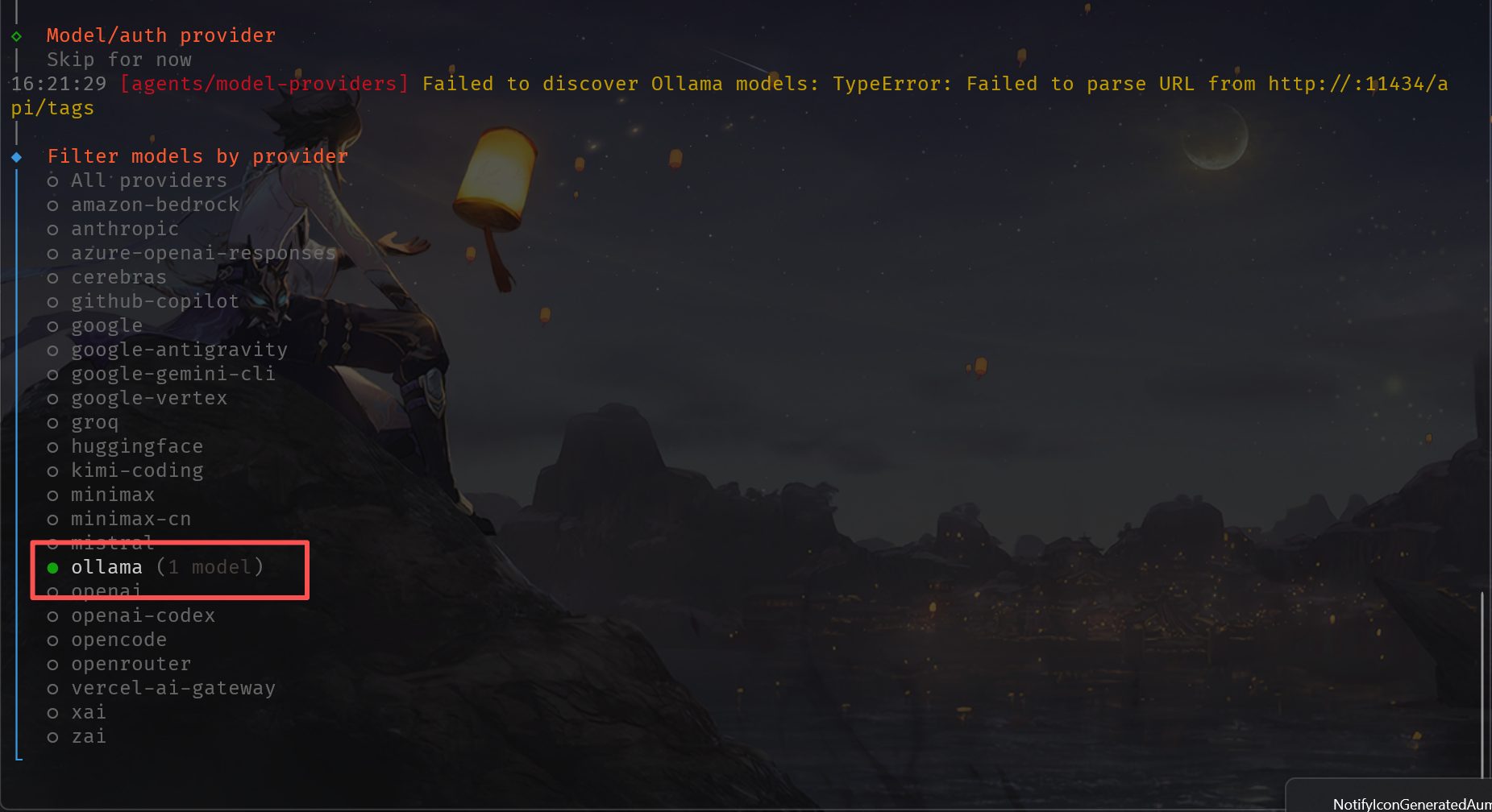

选择 ollama

选择模型

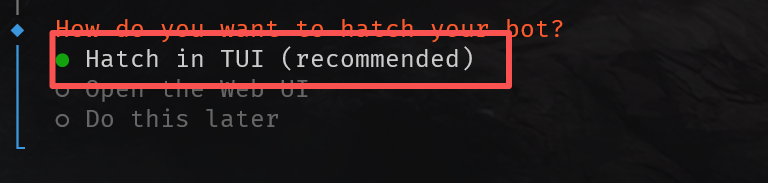

进入 TUI

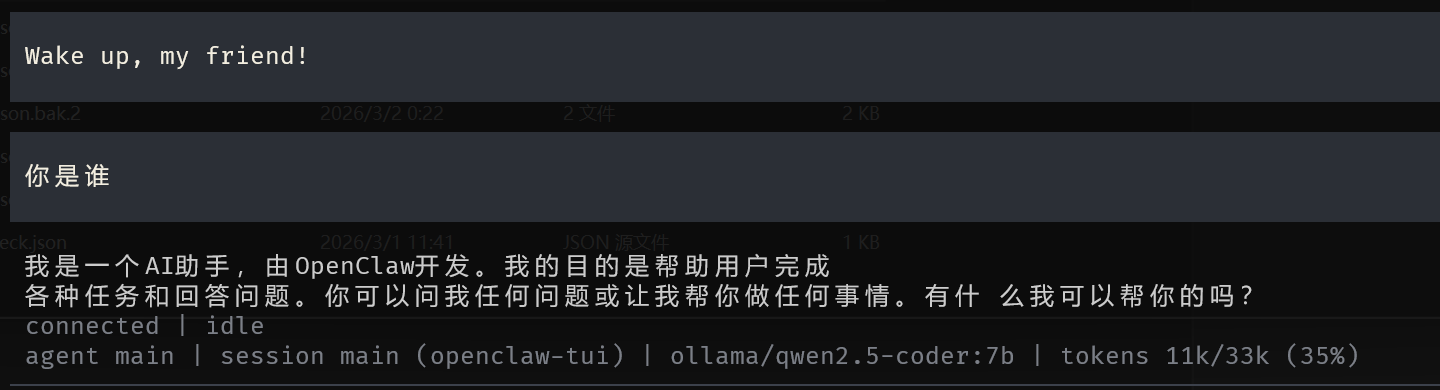

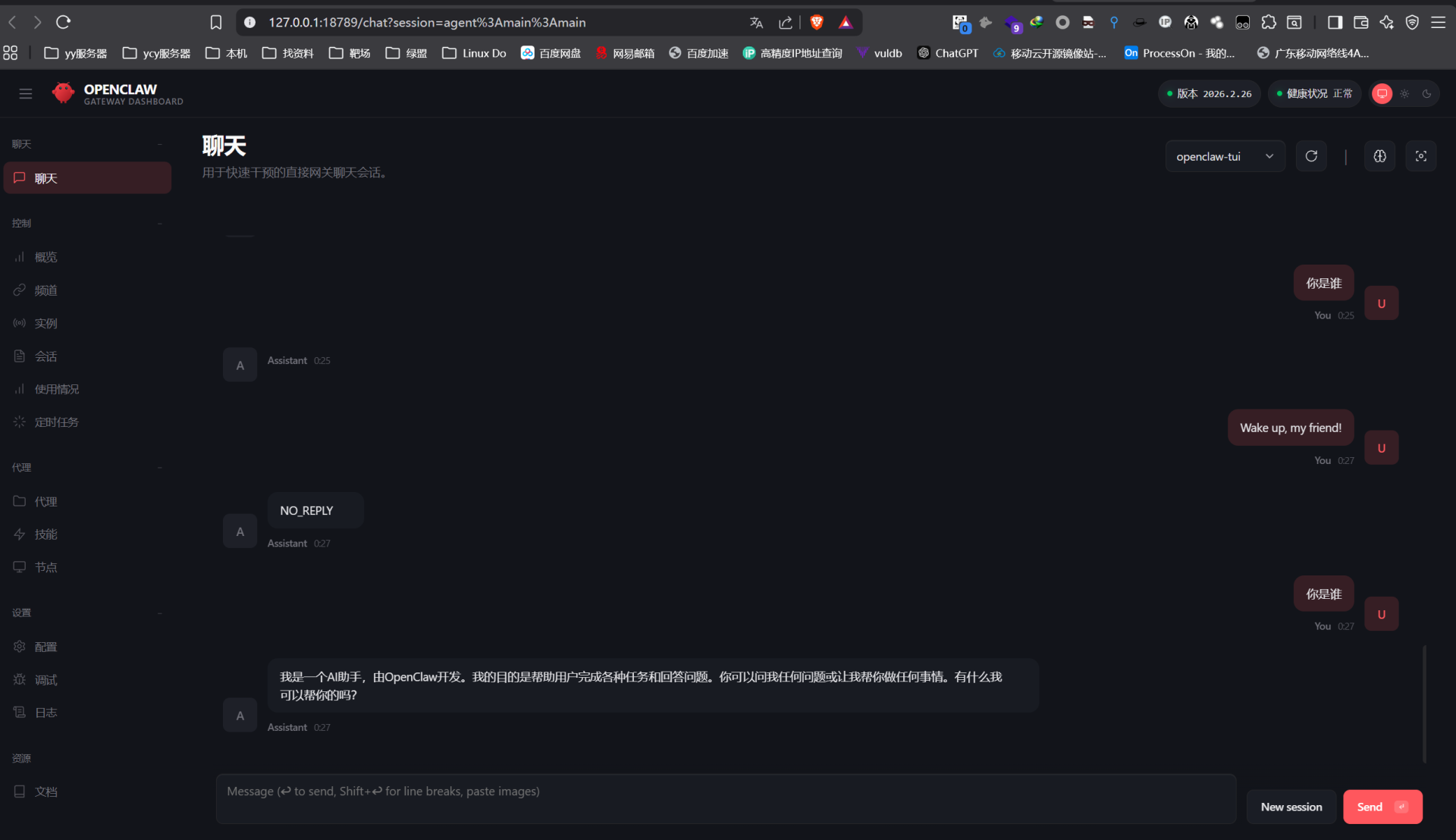

使用 openclaw

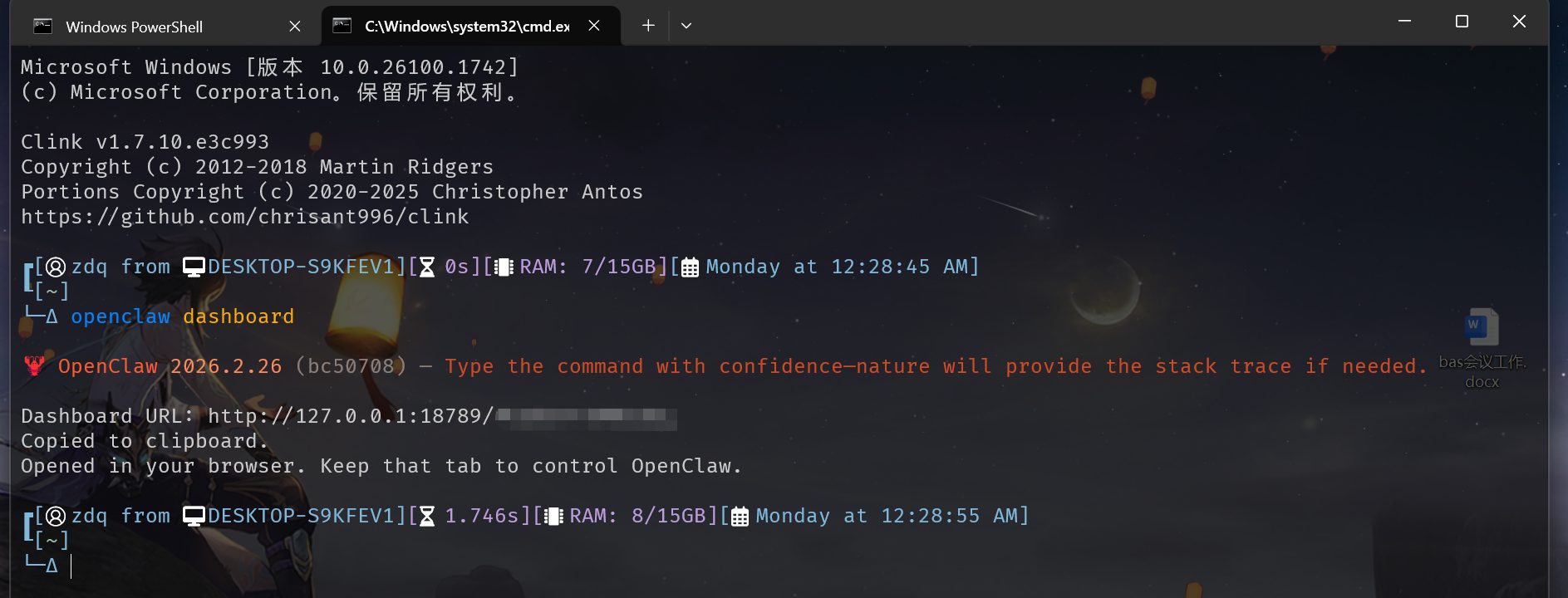

使用 openclaw web

openclaw dashboard

四、结语

至此,成功在 Windows 11 上打造了一个完全本地化、私有且强大的 AI 编程助手。它不仅能陪你讨论技术问题,还能直接操作你的电脑文件,真正将自然语言转化为生产力。

这套组合仅仅是开始。可以用 OpenClaw 庞大的技能库,连接笔记软件、任务管理工具,甚至让它帮你自动处理邮件。后面有空再写。